Apache hive 源码编译 2.1.0Apache hive | 查询和管理分布式存储中大型数据集

- 授权方式:免费软件

- 软件类型:国外软件

- 软件语言:英文

- 软件大小:160.19 MB

- 推荐星级:

- 软件厂商:Apache

- 更新时间:2016-08-14 11:58

- 网友评论:1 条

- 运行环境:WinXP, Win7, Win8, Win10

Compaq Fortran 6.6中文版 6.6 最终版360.04 MB

Compaq Fortran 6.6中文版 6.6 最终版360.04 MB Charles Https抓包工具 4.756.1 MB

Charles Https抓包工具 4.756.1 MB IDA Pro 7.5 Windows 破解版 7.5 绿色版409.8 MB

IDA Pro 7.5 Windows 破解版 7.5 绿色版409.8 MB 易语言免安装版 5.93 官方版98.6 MB

易语言免安装版 5.93 官方版98.6 MB 易语言5.8完全版 5.8.186 KB

易语言5.8完全版 5.8.186 KB Atmel Studio 7.0中文版 7.0.1931 免费版(附使用教程)817.05 MB

Atmel Studio 7.0中文版 7.0.1931 免费版(附使用教程)817.05 MB LAPACK 32位VS编译库 3.8.05.9 MB

LAPACK 32位VS编译库 3.8.05.9 MB APK反编译工具Apktool 2.0.3 最新版4.94 MB

APK反编译工具Apktool 2.0.3 最新版4.94 MB HiJson 32位 2.2 免费版5.35 MB

HiJson 32位 2.2 免费版5.35 MB

- 软件介绍

- 软件截图

- 相关软件

Apache Hive是建立在 Hadoop 上的数据仓库基础构架,它提供了一系列的工具,可以用来进行数据提取转化加载(ETL),这是一种可以存储、查询和分析存储在 Hadoop 中的大规模数据的机制,此次推荐的是官方版本的下载,有需要的赶快下载吧!

软件特色

1、设计特征:

支持索引,加快数据查询。

不同的存储类型,例如,纯文本文件、HBase 中的文件。

将元数据保存在关系数据库中,大大减少了在查询过程中执行语义检查的时间。

可以直接使用存储在Hadoop 文件系统中的数据。

内置大量用户函数UDF 来操作时间、字符串和其他的数据挖掘工具,支持用户扩展UDF 函数来完成内置函数无法实现的操作。

类SQL 的查询方式,将SQL 查询转换为MapReduce 的job 在Hadoop集群上执行。

2、体系结构:

主要分为以下几个部分:

用户接口

用户接口主要有三个:CLI,Client 和 WUI。其中最常用的是 CLI,Cli 启动的时候,会同时启动一个 Hive 副本。Client 是 Hive 的客户端,用户连接至 Hive Server。在启动 Client 模式的时候,需要指出 Hive Server 所在节点,并且在该节点启动 Hive Server。 WUI 是通过浏览器访问 Hive。

元数据存储

Hive 将元数据存储在数据库中,如 mysql、derby。Hive 中的元数据包括表的名字,表的列和分区及其属性,表的属性(是否为外部表等),表的数据所在目录等。

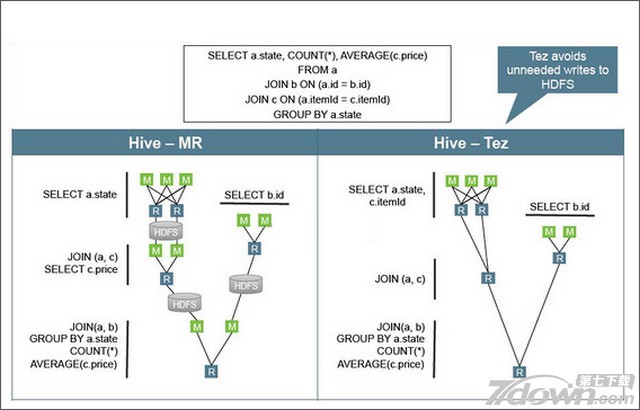

解释器、编译器、优化器、执行器

解释器、编译器、优化器完成 HQL 查询语句从词法分析、语法分析、编译、优化以及查询计划的生成。生成的查询计划存储在 HDFS 中,并在随后由 MapReduce 调用执行。

Hadoop

Hive 的数据存储在 HDFS 中,大部分的查询由 MapReduce 完成(包含 * 的查询,比如 select * from tbl 不会生成 MapReduce 任务)。

视频编辑软件

视频编辑软件对于多媒体视频爱好者而言,Video Editor视频编辑软件是不可缺少的工具,裁剪cropper、分割splitter、截取cutter,转换视频格式、合并等,充分发挥你的想象力。所谓工欲善其事,必先利其器,好的工具可以令你做起视...

猜你喜欢

.NET Reflector 9中文版 9.0 中文版

.NET Reflector 9中文版 9.0 中文版 编译调试 / 13.25 MB

Fortran编译器Win10 6.6 兼容版

Fortran编译器Win10 6.6 兼容版 编译调试 / 359.86 MB

Charles 64位 Win10 4.7

Charles 64位 Win10 4.7 编译调试 / 56.1 MB

IDA Pro 7.5 64位破解版 7.5 免费版

IDA Pro 7.5 64位破解版 7.5 免费版 编译调试 / 409.8 MB

.Net 反汇编工具dnSpy 2023 汉化特别版X64

.Net 反汇编工具dnSpy 2023 汉化特别版X64 编译调试 / 79.5 MB

Koala编译器 2.0.4

Koala编译器 2.0.4 CMake 32位 3.25.1 官方版

CMake 32位 3.25.1 官方版 Fortran90编译器 4.0 正式版 32/64位

Fortran90编译器 4.0 正式版 32/64位 汇编语言编译器 1.0 免费版

汇编语言编译器 1.0 免费版 FreeBasic 1.05.0

FreeBasic 1.05.0 Aardio编译器 14.14

Aardio编译器 14.14 GCC编译器中文版 11.2.0

GCC编译器中文版 11.2.0 CodeBlocks中文版 17.12-1 汉化版

CodeBlocks中文版 17.12-1 汉化版 HawkOD调试器破解 1.2.3 中文特

HawkOD调试器破解 1.2.3 中文特 Compaq Visual Fortran 32位版

Compaq Visual Fortran 32位版 Charles破解 3.11 32位/64位完全

Charles破解 3.11 32位/64位完全 OllyDBG吾爱破解专版 吾爱专用

OllyDBG吾爱破解专版 吾爱专用 Charles Windows版 4.2.8 破解版

Charles Windows版 4.2.8 破解版 Charles 32位 4.7

Charles 32位 4.7 IDA Pro 7.5 32位破解版 7.5 免

IDA Pro 7.5 32位破解版 7.5 免 VMP加壳工具汉化版 3.4.0.1167

VMP加壳工具汉化版 3.4.0.1167 MinGW Windows 8.1.0

MinGW Windows 8.1.0

软件评论

请自觉遵守互联网相关政策法规,评论内容只代表网友观点,与本站立场无关!

2016-08-14 11:59 支持(8) 回复